从“OODA环”到具身智能的思考

CICC具身智能专委会

概述

人工智能正在经历一次深刻的能力重心转移:从以识别、分类、检索为代表的“感知智能”,逐步走向能够在真实环境中完成判断、选择与执行的“决策与行动智能”。在新一代信息技术推动下,视觉、听觉、触觉、位置与姿态等传感器被广泛嵌入手机、车辆、无人系统等各类智能终端,跨模态感知交互越来越普遍;云-边-端协同使远程监视、干预、遥控和协作更易实现;而机器人在执行任务时,本体行为与环境之间的连续耦合也更频繁、复杂。

具身智能(Embodied Intelligence)正是在这样的背景下成为重要方向,它不再满足于“看懂世界”,更强调在场景任务牵引下,把感知、认知、行动真正联结起来,让系统在与环境互动中形成闭环并持续迭代。李德毅院士提出,应把几十年来计算机“输入—输出”的设计演进,放回人类几千年“感知—认知—行动—再感知”的螺旋中思考,具身智能是人工智能的起点和归宿。这提示我们,智能的关键不只在于内部推理,更在于面向任务的闭环行动能力。

要构建这种闭环系统,来自于军事指挥控制领域的OODA环(观察-判断-决策-行动)理论是一个极具启发性的理论模型,其核心逻辑是循环迭代,关键要素是时间周期。即在复杂环境中,能够更快完成从观察到行动的闭环,并通过持续的循环迭代优化,圆满完成任务目标。在具身智能语境下,OODA环与“感知-认知-行动”闭环内在一致:观察对应多源信息感知融合,判断对应态势分析评估,决策对应策略选择,行动对应控制执行。每一次行动都会改变环境,进而影响下一轮观察,这正是具身系统“在交互中学习与适应”的基本机制。

这一思想亦与东方军事智慧呼应。1936年毛泽东在《中国革命战争的战略问题》中指出,“指挥员的正确的部署来源于正确的决心,正确的决心来源于正确的判断,正确的判断来源于周到的和必要的侦察,和对于各种侦察材料的联贯起来的思索。”这条“侦察-判断-决心-部署”的决策链条,深刻揭示了任务牵引下各环节的逻辑关联。对具身智能而言,面对充满噪声与不确定性的动态场景,系统必须将“看见什么—理解什么—选择什么—做到什么”连贯运行,并在迭代中保持有效。

那么,如何以“OODA环”为框架,构建更高效、更适应复杂环境的具身智能系统?本文将从研究现状出发,深入分析具身智能实现的OODA范式,结合典型应用场景进行关键技术研究,并对未来发展方向进行展望。

一、具身智能研究现状及挑战

1.1 具身智能:不仅仅是“有身体的AI”

具身智能的核心在于强调“智能”需要依托物理(或可作用于环境的)“躯体”,在与环境的持续交互中产生与发展。也可以理解为,智能体通过躯体、大脑与环境紧密耦合而涌现出的智能行为。具身性(依赖躯体感知与运动器官)、情境性(嵌入具体环境完成任务)和发展性(通过交互积累经验实现进化)是其三个典型特征。

这与传统的“离身智能”(Disembodied Intelligence)显著不同。离身智能(如大语言模型)主要处理符号、图像、文本等信息,不关心信息如何获取、如何作用于物理世界。而具身智能强调智能体通过身体、大脑与环境紧密耦合而涌现出的智能行为,智能不是预先编程好的,而是在交互过程中“生长”出来的。例如,同样是识别一只猫,传统AI靠海量图像训练;而具身智能体则可能通过移动视角、触碰毛发,甚至与猫互动来“理解”它。一个经典例证是心理学中的“小猫实验”:两只小猫接收相同视觉刺激,但只有能主动运动的小猫发展出正常的感觉-运动系统。这证明,智能不仅是“想”出来的,更是“动”出来的。

需要澄清的是,具身智能与机器人学密切相关但并不等同。具身智能研究的是“智能从交互中生成”的通用理论与方法;“身体”可以是机器人实体,也可以是其他物理装置甚至数字仿真体。机器人是具身智能的典型载体,但其智能行为未必都由具身范式产生。

1.2 当前研究进展:从“感知驱动行动”走向“多要素协同闭环”

近年来,具身智能研究已突破传统“感知→认知→行动”的线性范式,逐步向形态(Morphology)、行动(Action)、感知(Perception)、学习(Learning)四要素协同的闭环系统演进。

在核心技术层面,各模块正实现深度融合。感知层面,通过SLAM三维建图、动态目标检测与语义理解的结合,实现从“被动看到”到“主动理解”的跨越。认知层面则跳出纯大模型依赖,转向神经符号混合架构,由大模型解析自然语言指令、规则引擎生成可执行子任务序列,兼顾灵活性与可解释性。行动层面,以强化学习为基础,借助仿真环境大规模预训练后迁移至物理世界,结合模型预测控制实现动态平衡与精准操作。

在系统范式层面,研究重点正从对单个模块的专门优化,转向深入探索形态、行动、感知、学习四要素间的动态联结与相互促进机制。具体而言,学习过程中能够生成更优的行动策略;这些行动在执行时,又可通过主动探索环境,为目标性的数据采集创造条件,从而反过来优化感知模型;而持续交互所积累的经验与反馈,则进一步驱动学习模型的迭代与进化。这种“联接式”的系统视角深刻揭示:真正具有适应性与进化能力的智能闭环,并非感知、认知、行动等模块各自进化后的简单叠加,而是各要素在紧密耦合与持续互动中,通过相互促进、共同进化而涌现出的协同产物。

任务场景也随之拓展深化,从基础的视觉导航与操作,延伸至语言条件导航、视觉-语言-操作等复杂任务,并进一步强化“边走边看边问”的具身问答模式。与此同时,交互场景也从单一环境中的独立执行,升级为多智能体协同、人机共融等高复杂度形态。这一系列演进不仅反映了任务内涵的持续深化,更清晰展现了具身智能从“感知驱动行动”的单向模式,逐步发展为多模态、多主体协同的闭环复杂系统。这一发展脉络为高阶具身智能的实现奠定了坚实的理论与实践基础。

1.3 核心技术瓶颈:理想与现实的差距

尽管前景广阔,当前具身智能研究仍面临多重瓶颈,学术理想与工程现实间存在显著鸿沟。

其一,研究范式存在错位。许多“具身智能体”的研发仍沿用串行集成范式,本质是用依赖海量标注数据的离身智能方法论,去研究强调交互涌现的具身智能,导致系统难以实现通过环境交互自主进化的核心能力。

其二,形态仿生流于表面,智能贡献不足。足式、人形等多样形态多停留于生物外形模仿,其形态特征未对控制与感知设计形成有效支撑,反而因复杂度提升增加了算法优化难度,真正的“形态智能”尚未被充分挖掘。

其三,关键技术挑战突出。复杂非结构化、动态对抗性环境,对“感知-判断-决策-执行”全闭环构成严峻考验;仿真到现实迁移存在“现实差距”,虚拟训练策略难以直接落地物理世界;系统因涉及物理交互,面临对抗样本攻击等多样化安全威胁,且在未见场景下性能易大幅下滑;具身主动学习、主动感知等核心能力,还受限于物理环境样本稀缺、探索成本高、闭环稳定性差等问题。

其四,学科交叉融合不足。具身智能高度依赖材料、生物、心理等多学科支撑,但目前研究过度集中于计算机、自动化领域,材料、生物等学科参与度低,限制了仿生材料、神经启发控制等前沿方向的突破。

二、具身智能的OODA范式

2.1 OODA环:源自对抗场景的动态决策核心框架

OODA环由美国军事战略家约翰·博伊德提出,最初为破解空战战术博弈而生,后逐步演进为复杂动态环境下通用的智能决策框架。其核心逻辑是通过“观察(Observe)-判断(Orient)-决策(Decide)-行动(Act)”四环节的闭环迭代,实现对环境的快速适应与主动掌控。具体而言,“观察”表示全方位收集环境与对手的多源信息;“判断”表示基于已有知识、经验与文化背景,对信息进行过滤、分析与整合,形成对当前态势的独特认知;“决策”表示在研判基础上,生成并评估多种行动方案,从中做出选择;“行动”表示执行所选方案,作用于环境,并立即准备进入下一个“观察”环节,开启新一轮循环。

OODA环的精髓在于“快循环”与“强迭代”的哲学。在动态、不确定、对抗性的环境中,竞争优势并非来自一次完美的决策,而是来自比对手更快地完成“观察-行动”闭环,并能通过持续循环,利用行动反馈来修正观察、更新判断、优化决策。例如,自动驾驶汽车面对突然窜出的行人,必须在毫秒内完成“行人感知→策略选择→路径规划→控制避让”的完整闭环。

2.2 具身OODA环:OODA与具身智能的具身关联

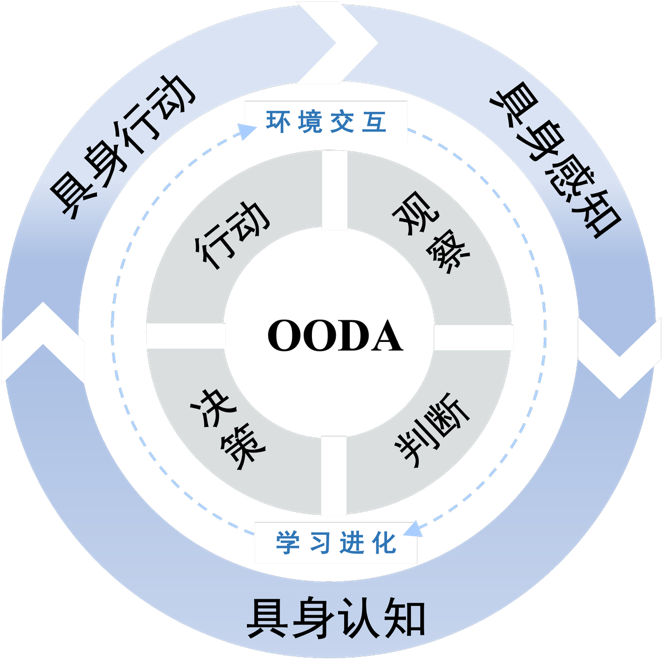

具身智能的本质在于“依托物理实体,通过与环境的实时交互实现感知、决策、行动与学习的智能形态”。这一本质使其与OODA环天然形成深刻的内在关联,这种关联不仅表现为流程上的逻辑呼应,更深层地体现在进化进制的内在统一上,如图1所示。基于此,本文提出“具身OODA环”概念,即依托具身智能技术构建全流程高度自主、可快速迭代的闭环系统。

图1 具身OODA环

逻辑映射与流程对应:从流程上看,具身智能的“感知-认知-行动”链路与OODA环四环节具有清晰的对应关系。具体而言,感知系统对应于“观察”,负责通过多模态传感器捕获环境信息;认知系统覆盖“判断”与“决策”,既需整合分析信息,也需规划行动方案;行动系统则直接执行“行动”,将抽象决策转化为具体动作。这一对应关系使OODA环成为具身智能系统设计的自然框架,为技术集成提供了逻辑主线。

进化机制的内在统一:更深层的关联在于进化机制的统一。OODA环强调“行动改变环境,反馈优化决策”的闭环迭代,这与具身智能“在交互中成长”的具身特征高度契合。具身智能体并非被动执行指令,而是通过行动获得环境反馈(如动作偏差、任务状态、环境变化等),并据此动态调整感知参数、优化认知模型、修正行动策略,实现持续自我进化。例如,服务机器人通过多次开门动作的反馈,逐步优化机械臂的转动角度与力度,最终实现精准操作,这正是OODA环迭代机制在具身系统中的具体体现。

本文提出的“具身OODA环”概念,其核心特征包括三方面:1)全流程自主化,即显著降低人工干预,实现从信息采集到动作执行的端到端自主运行;2)技术集成化,即融合多模态感知、强化学习、大模型等技术,形成协同赋能的技术体系;3)动态进化性,即通过持续的环境交互实现能力的自我优化,适应开放动态场景。此外,系统也需支持高效的“人在环中”协同,即机器负责快速采集与初步处理数据,人类则聚焦关键决策与价值校准,从而兼顾机器的高效运算与人类的经验判断。

2.3 支撑OODA范式的核心技术及案例

为实现高效、鲁棒的具身OODA闭环,需围绕观察、判断、决策、行动四环节构建针对性技术体系,并依托跨环节赋能技术强化协同与迭代能力,形成完整技术矩阵。

2.3.1 观察环节:多模态主动感知,筑牢信息基础

观察环节的核心目标是“全维度、高精度、低风险”获取环境信息,为后续认知决策提供支撑,核心技术是多模态融合与主动感知,即通过“多源互补+主动探索”提升感知可靠性。

多源异构信息融合是基础支撑。在强干扰、多遮蔽的复杂场景中,单一模态传感器容易失效,需整合雷达、光电、声学、通信信号等多源数据,通过知识图谱与图神经网络挖掘跨模态关联,构建“数据处理-动态关联-知识提炼”的三层融合框架,并结合在线学习实现自适应迭代,形成“越用越准”的正反馈。例如在仓储物流场景中,自动导引车(AGV)通过融合视觉、激光雷达以及IMU数据,可实现与机械臂协同所需的毫米级定位与货品精准识别抓取。

主动感知与隐蔽感知是进阶方向。主动感知可突破被动接收信息的局限,智能体通过调整自身姿态、移动位置或主动发射探测信号(如激光、毫米波),可改善感知效果,这正是具身智能“行动改进感知(A→P)”范式的核心。例如,在识别侧向人脸时,无需训练复杂的侧向人脸识别模型,只需控制摄像头转向正面即可实现准确识别。在对抗场景中,不仅要“看得清”,还要“藏得好”。采用低截获概率雷达、被动声呐、红外隐身等技术,在获取信息的同时可以最小化自身暴露风险。主动感知与隐蔽感知是面向复杂、对抗性环境的两个重要进阶方向,二者目标不同,可共同构成智能体在动态场景中的感知优势。

2.3.2 判断-决策环节:大模型赋能,实现精准高效决策

该环节聚焦“快速认知”与“稳健决策”,需应对动态场景下的态势理解、威胁评估与博弈优化,核心技术包括大模型知识基座、混合推理与对抗博弈决策等。

大模型驱动的态势认知是能力基础。以GPT、DeepSeek等预训练大模型为知识基座,结合动态记忆网络(短期处理当前任务、长期存储历史经验等),可实现对复杂场景的深度理解与趋势预判。例如,接到“把客厅打扫干净”的指令后,机器人能自行分解为“识别杂物→规划清扫路径→抓取垃圾→返回充电”等子任务。同时,为解决大模型“决策黑箱”问题,可采用“大模型+规则引擎”的混合架构:大模型负责意图解析与模糊推理,规则引擎生成标准化战术步骤(如“先压制防空→再打击雷达”),兼顾决策效率与可解释性。

对抗博弈决策是动态场景的关键突破。在军事对抗、多智能体协作等场景中,环境存在强不确定性,需将场景建模为敌我博弈系统,通过强化学习进行实时推演,生成多套备选方案并评估风险效能,以实现从“被动应对”到“主动博弈”的转变。这种决策模式并非一次性输出,而是结合行动反馈进行滚动优化,形成“决策-行动-反馈-优化”的在线学习闭环。

2.3.3 行动环节:鲁棒控制与技能迁移,保障物理交付

行动环节的核心是“精准、安全、稳健”地将决策转化为物理动作,需解决复杂环境下的稳定性控制与技能落地问题,核心技术包括鲁棒控制、形态计算与Sim2Real技能迁移等。

自适应鲁棒控制是系统稳定性的保障。针对复杂地形、外部干扰(如冲击、负重变化)等场景,需采用融合鲁棒控制、自适应控制与强化学习等算法,让机器人在动态环境中保持稳定性能。对于人形机器人等高冗余自由度智能体,需通过统一控制空间设计实现全身协同运动,同时借鉴生物柔性特性实现仿生柔顺控制,提升环境适应性与人机交互安全性。

形态计算与Sim2Real技术可大幅提升落地效率。形态计算的核心思想是将部分计算任务从“大脑”(控制器)卸载到“身体”(机械结构)本身。例如“被动行走机器人”通过特殊腿部结构设计,无需主动控制即可在斜坡上实现稳定的步态行走,极大简化了控制算法。Sim2Real技术则通过“虚拟训练-真实迁移”的路径,大幅缩短技能训练周期。在仿真环境中通过域随机化等方法丰富场景,预训练行走、抓取等基础技能,再通过缩小感知/动作空间差距,实现向物理世界的精准迁移。典型例子如足式机器人在仿真环境进行动态平衡技能训练,可大大提高机器人崎岖不平路面的通过能力。

2.3.4 跨环节赋能技术:驱动闭环迭代与协同进化

除各环节核心技术外,还有三类跨环节赋能技术,即行动驱动学习、多智能体协同以及数字孪生,可为OODA闭环提供“进化动力”与“协同能力”。

行动驱动学习(A→L)是闭环进化的核心。与传统“被动接收数据”的机器学习不同,具身智能体通过主动探索环境,针对性采集薄弱环节数据(如对某类物体识别精度低时,主动发起交互),通过自监督学习或少量人工标注生成标签,微调感知与认知模型,实现“越用越聪明”的持续进化。比如,斯坦福大学最新研究发现,引入“好奇心驱动”机制可引导AI像孩子一样“边玩边学”,提升智能体的学习效率。

弹性多智能体协同可拓展闭环边界。将单个智能体的OODA环扩展为分布式OODA网络,通过抗干扰通信技术与分布式共识算法,实现无人机、地面机器人等异构智能体的协同决策与任务分配,即使在部分节点失效或通信受限场景下,仍能保障整体任务完成。例如,军事场景中的“无人机集群侦察+地面机器人打击”协同,各智能体分工完成观察、决策、行动环节,通过网络实现信息共享与策略协同。

数字孪生可构建虚实协同闭环。通过融合物理模型与传感器数据,在虚拟空间构建具身智能体与任务场景的数字化镜像,可实现任务预演、风险预判与战术优化。英伟达的Isaac Sim机器人仿真平台便是这一理念的典型实践。该平台能在高保真的虚拟环境中,精确模拟机器人本体动力学、各类传感器(如摄像头、激光雷达)以及复杂多变的外部场景(如不同光照、天气、地形)。研究人员和开发者可在此安全、高效的虚拟世界中,让智能体完成导航、抓取、协同等大量技能训练与算法迭代,并将训练所得的策略模型直接迁移至物理机器人,从而极大加速开发流程、降低实物测试成本与风险,并持续优化其在实际环境中的OODA闭环性能与适应能力。

小结:OODA环为具身智能提供了“感知-认知-行动-反馈”的闭环框架,而具身智能技术则使其发展为“全自主、可进化、强协同”的智能系统。通过上述技术矩阵支撑,OODA范式已形成可工程化落地的“闭环能力栈”,为多领域应用奠定基础。

三、具身智能典型任务场景及应用——从陆、海、空、天到跨域协同

具身智能的能力演进,可依据任务复杂度及其对OODA环(观察、判断、决策、行动)各阶段的依赖程度来划分:从结构化环境中基于“观察-行动”(O–A)的端到端精准控制,到半结构化场景中引入“判断与决策”(O–D–A)的认知介入,再到非结构化复杂环境下实现完整OODA闭环的动态自主控制,最终迈向跨域协同的分布式OODA网络构建。这一演进路径,既体现了任务环境不确定性的逐步增加,也揭示了具身智能从“执行工具”向“自主代理”、再向“群体智能节点”的持续跃迁。

3.1 陆域场景:从封闭园区到野外环境

在陆域场景中,具身智能体呈现出丰富的形态多样性,其设计深度适配特定任务需求与环境条件。

在结构化工业环境中,系统主要聚焦于高精度感知与可靠执行,OODA环中的“判断”与“决策”相对固定,核心在于提升观察(O)与行动(A)的效率与鲁棒性。例如,在仓储物流场景中,自动导引车需要与机械臂协同完成“货品识别—路径规划—搬运—码垛”全流程,对毫米级定位与多模态传感融合提出高要求。

在半结构化环境(如家庭、商场)中,服务机器人需要引入O–D–A认知介入,强化判断与决策能力。云鲸J4扫地机器人通过多光谱识别地面材质(地毯、瓷砖),自动切换清洁模式;Figure 01等人形机器人能理解“收拾厨房”等模糊指令,并将其分解为识别餐具、抓取、放入洗碗机等一系列子任务。

在非结构化地面环境(如野外、战场、灾难废墟)中,则需完整OODA环的支持,以实现实时感知、快速判断、敏捷决策与鲁棒执行的动态闭环。例如,在野外侦察或城市巷战中,无人地面车辆需在无路、强扰动的环境中进行高动态机动与隐蔽突入,其成功依赖于模型预测控制与深度强化学习相结合的混合规划框架,对全OODA环的实时性和鲁棒性构成巨大考验。

3.2 海域场景:从水面搜救到水下作业

目前,无人船通过集成应急通信、目标识别、自主导航、智能救援、水质监测、水下地形测绘等功能,逐步发展成为“搜救-监测-指挥”一体化的智能具身平台。通过引入强化学习等算法,无人船能够持续优化在复杂环境下的自主决策能力,例如在激流中动态调整救援路径,或协同多艘无人船高效完成大规模水域搜救任务。

水下环境具有通信困难、能见度低、流场复杂等突出特点,对具身智能的感知与控制能力提出了更高要求。具体来看,不同形态的水下机器人已针对各类任务进行了专门化设计:鳍式机器人(如仿生鱼机器人)通过尾鳍摆动实现高效推进,适合水下细致勘探与生物观测;螺旋桨式机器人(如ROV遥控潜水器)通常搭载机械臂,可用于深海采矿或沉船打捞等作业任务;水下滑翔机则利用浮力变化实现滑翔前进,续航可达数月,适用于大范围、长周期的海洋环境监测。典型案例如美国伍兹霍尔海洋研究所开发的深海机器人Orpheus,可在6000米水深下长期自主作业,并支持与其他水下平台协同,形成分布式探测网络。此类系统代表了水中具身智能在极端物理约束与弱感知条件下,实现全OODA闭环的前沿水平。

值得关注的是,在军事应用场景中,水下机器人需应对一系列严峻挑战。例如,通过调整吃水深度或螺旋桨推力以抵消风浪干扰;利用声呐扫描地形并实时重规划路径以规避暗礁;根据实时洋流速度动态调整动力输出以保持航迹;以及通过耐压壳体设计与压力传感器反馈机制,确保设备在深水高压环境下的安全运行。这些复杂场景对水下具身智能系统的感知、决策与控制闭环提出了更高要求。

3.3 空域场景:从侦察巡航到空中博弈

空域具身智能体在军事突防、边境巡逻和应急侦察等任务中,长期面临高速、高机动与强对抗的复杂挑战。为适应不同场景需求,已衍生出多种形态的无人机平台,各具特色。

其中,旋翼无人机(如多旋翼机型)凭借垂直起降灵活、悬停稳定的特点,广泛应用于低空侦察、精准物流等场景。以我国研发的“蜂群”无人机为例,该系统可在复杂山地或城市环境中实施低空突防,通过灵活利用地形起伏实现雷达遮蔽,显著降低被探测概率;在卫星导航信号受拒止的极端条件下,借助视觉-惯性里程计与高精度地形匹配算法,实现厘米级精准悬停,并持续锁定地面目标。

另一方面,喷气/滑翔类无人机(以固定翼为代表)则以其续航长、速度快的特点,主要用于广域侦察、长程巡航与高速测绘等任务。此外,扑翼无人机作为新兴形态,通过模仿鸟类飞行机制,具备噪音低、隐蔽性强的独特优势,非常适用于静默侦察、生态监测等对隐蔽性要求极高的场合。

在实战背景下,无人机常需完成一系列高难度飞行动作,例如筋斗、横滚(用于高机动规避)、低空突防(借助地形遮蔽规避雷达探测)、悬停瞄准(在稳定悬停中锁定目标),以及在多机编队中实时调整位置的协同变换。这不仅对飞行控制算法的鲁棒性提出极高要求,也促使系统向轻量化、一体化的感知-决策架构演进,从而在有限机载算力下实现从观察到行动的全OODA闭环,确保在动态对抗环境中仍能可靠、自主地完成任务。

3.4 天域场景:从在轨服务到星球探测

太空探索与开发也正成为具身智能的关键前沿领域。天域环境具有微重力、高辐射、极端温度、高真空及显著通信延迟等严苛约束,对智能体的自主性、可靠性与长期生存能力提出极致要求。其应用主要围绕在轨服务与星球探测两大方向展开。

在轨服务方面,在轨服务飞行器需在无人工实时干预下,自主完成对故障卫星的逼近、捕获、维修、燃料加注或轨道转移等精细操作。例如,NASA的OSAM-1(在轨服务、组装与制造)任务旨在验证机器人自主执行卫星维修与部件组装的能力。此类任务依赖高度自主的OODA闭环,智能体必须在复杂的多体动力学环境中,通过视觉、激光雷达等多模态感知实时判断目标状态,规划安全的逼近轨迹与操作序列,并执行高精度、柔顺的机械臂操作。

在星球探测方面,星球车(如月球车、火星车)需要在通信延迟长达数分钟甚至数十分钟的条件下,在未知、非结构化的地表环境中实现长期自主导航与科学探测。以“毅力号”火星车为例,其搭载的自主导航系统ENav能基于立体视觉实时构建地形图,规划安全路径,成功实现35cm级障碍物自主避让。这标志着其OODA环已从“地面遥操作闭环”向“星上自主闭环”演进。未来,更具挑战性的任务将包括在永久阴影区等极端环境下的自主探测,以及多机器人协同构建前哨站等。

天域场景代表了具身智能在物理约束与自主性需求上的双重极限,是推动其向全自主、高可靠、长寿命方向演进的重要试验场。

3.5 跨域协同场景:分布式OODA网络的构建

未来,无论是高烈度作战还是大规模应急响应,其任务形态都在加速向“多域融合、异构协同”演进。面对单一智能体在感知覆盖、机动能力或任务专精上的固有局限,亟需构建分布式OODA网络——将观察、判断、决策与行动能力分散部署于空、天、地、海等异构平台中,通过统一态势共享与动态任务协同,实现“1+1>2”的群体智能跃迁。

典型协同结构在实践中已呈现出清晰的形态谱系:陆+空结构(如飞行汽车、可变形无人机),旨在通过陆地行驶与空中飞行的模式切换,高效解决交通拥堵或复杂地形障碍;海+空结构(如水上飞机、潜射无人机),则着眼于实现水面起降与空中作业的无缝衔接,尤其适用于海洋搜救、反潜侦察等任务;而海+陆+空+天结构,则代表了未来体系化作战与全域响应的终极协同形态。

这种协同范式在具体任务中如何运转?可设想一个城市特战场景:空中低空无人机和地面机器人作为“先锋观察哨”,渗透侦查,这个过程中要利用地形地貌、气象条件等进行伪装,实施电子静默,避免被敌方雷达、红外侦察设备发现,通过智能感知侦查装备,快速构建带语义标签的3D环境地图并精准识别敌方火力点,与后方指挥中枢保持信息联络,及时反馈侦查进展和战场态势;指挥中心根据目标信息和战场态势,制定突击方案、路线、作战单元分工、火力配置及协同方式;负责打击的空中和地面无人系统作为“主力执行单元”,实时规划出最优的隐蔽突入路径,前出执行精确打击,打击过程中根据任务完成情况动态协同;任务完成后,回传毁伤评估结果,从而驱动整个分布式系统启动新一轮OODA循环,实现快速迭代与自适应优化。

此类跨域协同范式,标志着具身智能正从“单体自主”的时代,迈入“协同化、网络化的群体智能”的关键跃迁阶段。

四、未来展望与总结

“从交互中产生”的具身智能与OODA之间具有天然的联系。本文从OODA环的角度出发诠释了具身智能的核心内涵。未来的发展演进将呈现三大核心趋势:从追求“快循环”升级为“预循环”,通过世界模型与仿真推演实现先机预判;从“个体环”演进至“社会环”,构建人、机、环境意图共享与协同的超级闭环;并最终迈向“跨本体智能”,实现通用任务能力在不同物理载体间的动态迁移与协同执行。这一过程,正是“具身OODA环”不断加速、深化与网络化的体现。

具身智能作为当前人工智能与机器人学交叉领域的前沿方向,其理论探索与技术实践都在快速发展之中。本文尝试以OODA环这一经典框架为线索,对具身智能的内涵、范式、应用与趋势进行了梳理与解读。文中观点与阐释均基于作者个人的研究理解与行业观察,限于学识与视野,论述中难免存在疏漏与偏颇之处。在此抛砖引玉,诚请各位专家学者、业界同仁不吝批评指正,以期共同推动对这一重要方向的深入探讨与实践进步。

诚挚邀请从事具身智能研究、技术开发与产业应用的专家学者、业界同仁,加入中国指挥与控制学会具身智能专业委员会,共促领域学术交流与技术创新发展。

联系人:李志伟 17801095146(微信同号)